پاسخ علیبابا به DeepSeek، مدل جدید Mixture-of-Experts (MoE) این شرکت به نام Qwen 2.5-Max است.

Qwen 2.5-Max دارای پیشآموزش بر روی بیش از ۲۰ تریلیون توکن و تنظیم دقیق از طریق تکنیکهای پیشرفتهای مانند تنظیم دقیق تحت نظارت (SFT) و یادگیری تقویتی از بازخورد انسانی (RLHF) است.

با در دسترس بودن API از طریق Alibaba Cloud و امکان دسترسی به مدل برای کاوش از طریق Qwen Chat، غول تکنولوژی چین از توسعهدهندگان و محققان دعوت کرده است تا دستاوردهای خود را از نزدیک مشاهده کنند.

عملکرد برتر نسبت به رقبای خود

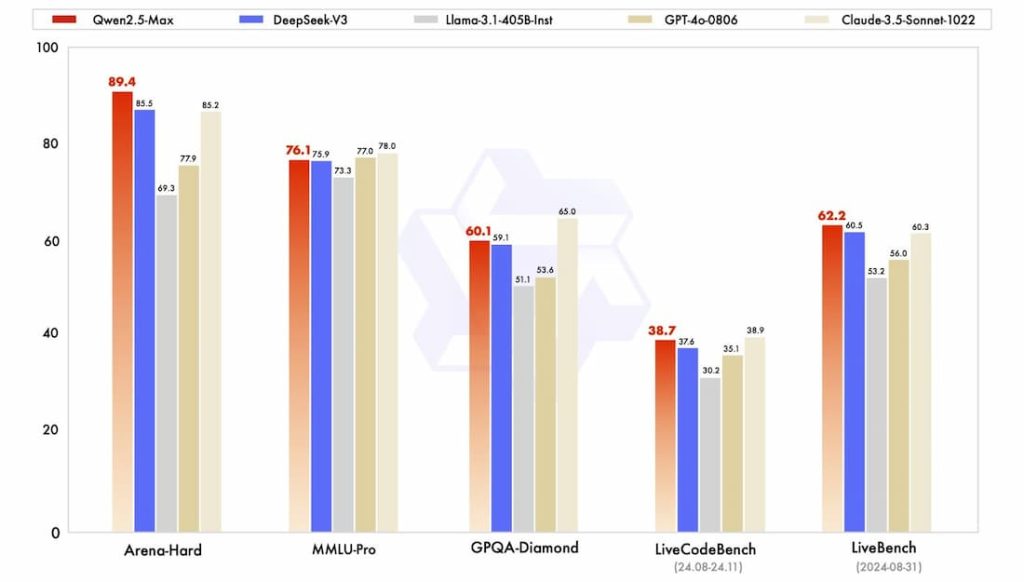

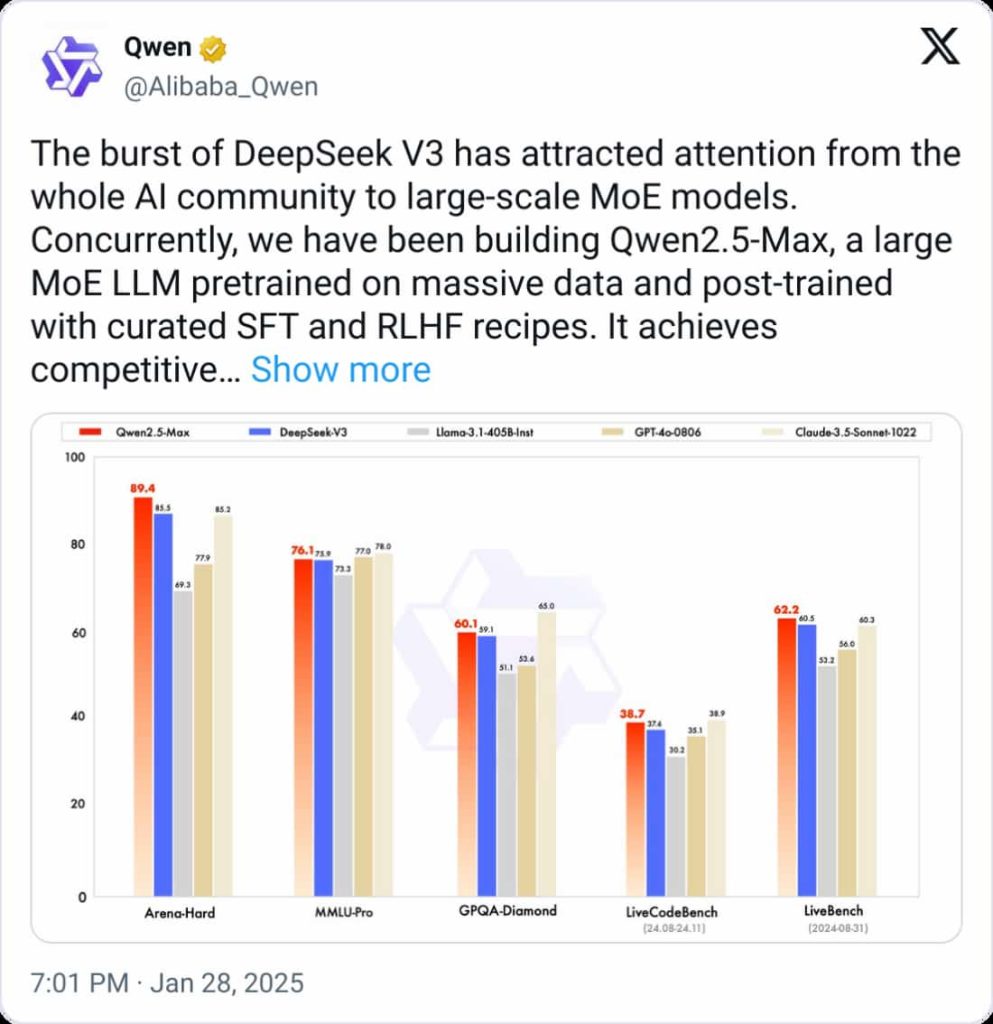

وقتی عملکرد Qwen 2.5-Max با برخی از برجستهترین مدلهای هوش مصنوعی در معیارهای مختلف مقایسه میشود، نتایج امیدوارکننده است.

ارزیابیها شامل معیارهای محبوبی مانند MMLU-Pro برای حل مسائل در سطح دانشگاهی، LiveCodeBench برای تخصص در کدنویسی، LiveBench برای ارزیابی قابلیتهای کلی و Arena-Hard برای ارزیابی مدلها در برابر ترجیحات انسانی بودند.

طبق گفته علیبابا، “Qwen 2.5-Max در بنچمارکهایی مانند Arena-Hard، LiveBench، LiveCodeBench و GPQA-Diamond از DeepSeek V3 عملکرد بهتری دارد، در حالی که نتایج رقابتی نیز در ارزیابیهای دیگر، از جمله MMLU-Pro، نشان میدهد.”

مدل instruct – که برای وظایف پاییندستی مانند چت و کدنویسی طراحی شده است – مستقیماً با مدلهای پیشرو مانند GPT-4o، Claude-3.5-Sonnet و DeepSeek V3 رقابت میکند. در میان این مدلها، Qwen 2.5-Max توانست در چندین زمینه کلیدی از رقبا پیشی بگیرد.

مقایسه مدلهای پایه نیز نتایج امیدوارکنندهای به همراه داشت. در حالی که مدلهای اختصاصی مانند GPT-4o و Claude-3.5-Sonnet به دلیل محدودیتهای دسترسی خارج از دسترس بودند، Qwen 2.5-Max در مقابل گزینههای عمومی پیشرو مانند DeepSeek V3، Llama-3.1-405B (بزرگترین مدل چگال با وزنهای باز) و Qwen2.5-72B ارزیابی شد. باز هم، تازهوارد علیبابا عملکرد استثنائی در تمام زمینهها نشان داد.

علیبابا اعلام کرد: “مدلهای پایه ما در اکثر بنچمارکها مزایای قابل توجهی را نشان دادهاند و ما خوشبین هستیم که پیشرفتهای تکنیکهای پس از آموزش، نسخه بعدی Qwen 2.5-Max را به ارتفاعات جدیدی خواهد رساند.”

برای دسترسی بیشتر به این مدل در سطح جهانی، علیبابا Qwen 2.5-Max را با پلتفرم Qwen Chat خود یکپارچه کرده است، جایی که کاربران میتوانند به طور مستقیم با مدل در ظرفیتهای مختلف تعامل داشته باشند—چه برای کاوش در قابلیتهای جستجو و چه برای آزمایش درک آن از پرسشهای پیچیده.

برای توسعهدهندگان، API Qwen 2.5-Max هماکنون از طریق Alibaba Cloud تحت نام مدل “qwen-max-2025-01-25” در دسترس است. کاربران علاقهمند میتوانند با ثبتنام در حساب Alibaba Cloud، فعالسازی سرویس Model Studio و ایجاد یک کلید API شروع کنند.

این API حتی با اکوسیستم OpenAI سازگار است، که یکپارچگی آن را برای پروژهها و جریانهای کاری موجود ساده میکند. این سازگاری مانع ورود کسانی که مشتاق به آزمایش برنامههای خود با قابلیتهای مدل هستند را کاهش میدهد.

علیبابا با Qwen 2.5-Max بیانیهای قوی از قصد خود اعلام کرده است. تعهد مستمر این شرکت به مقیاسگذاری مدلهای هوش مصنوعی نه تنها در راستای بهبود بنچمارکهای عملکرد بلکه به منظور ارتقای تواناییهای تفکر و استدلال پایهای این سیستمها است.

علیبابا خاطرنشان کرد: “مقیاسگذاری دادهها و اندازه مدل نه تنها پیشرفتهای هوش مدل را نشان میدهد بلکه تعهد راسخ ما به تحقیق پیشگامانه را نیز منعکس میکند.”

با نگاه به آینده، تیم قصد دارد مرزهای یادگیری تقویتی را گسترش دهد تا مهارتهای استدلال پیشرفتهتری را پرورش دهد. آنها میگویند این امر میتواند به مدلهایشان این امکان را بدهد که نه تنها با هوش انسانی برابر شوند بلکه از آن پیشی بگیرند در حل مسائل پیچیده.

پیامدها برای صنعت میتواند عمیق باشد. با بهبود روشهای مقیاسگذاری و شکستن مرزهای جدید توسط مدلهای Qwen، احتمالاً شاهد تاثیرات بیشتری در زمینههای مختلف مبتنی بر هوش مصنوعی در سطح جهانی خواهیم بود که در هفتههای اخیر مشاهده کردهایم.

منبع: اخبار هوش مصنوعی