من از سال ۲۰۱۸ با هوش مصنوعی کار کردهام و با علاقهای فراوان شاهد پذیرش آهسته اما پیوسته آن، همراه با گرایشهای بیبرنامه و شتابزده در این حوزه هستم. اکنون که ترس اولیه از سلطه رباتها تا حدی فروکش کرده، بحث درباره اخلاقیاتی که ادغام هوش مصنوعی در ساختارهای روزمره کسبوکارها را احاطه خواهد کرد، جایگزین آن شده است.

طیف کاملاً جدیدی از نقشها برای مدیریت اخلاق، حاکمیت و انطباق مورد نیاز خواهد بود که همگی از ارزش و اهمیت زیادی برای سازمانها برخوردار خواهند شد.

احتمالاً مهمترین این نقشها، متخصص اخلاق هوش مصنوعی خواهد بود که وظیفه دارد اطمینان حاصل کند سیستمهای هوش مصنوعی عامل (Agentic AI) با استانداردهای اخلاقی مانند عدالت و شفافیت همراستا هستند. این نقش شامل استفاده از ابزارها و چارچوبهای تخصصی برای رسیدگی کارآمد به نگرانیهای اخلاقی و جلوگیری از خطرات قانونی یا آسیب به اعتبار است. نظارت انسانی برای تضمین شفافیت و اخلاق مسئولانه ضروری است تا تعادل ظریفی بین تصمیمگیریهای مبتنی بر داده، هوش و شهود حفظ شود.

علاوه بر این، نقشهایی مانند طراح جریان کار هوش مصنوعی عامل، طراح تعامل و ادغام هوش مصنوعی، اطمینان خواهند داد که هوش مصنوعی بهطور یکپارچه در اکوسیستمها ادغام شده و شفافیت، ملاحظات اخلاقی و انطباقپذیری را در اولویت قرار میدهد. همچنین به یک ناظر هوش مصنوعی نیاز خواهد بود تا کل مجموعه عوامل و داوران در سیستم هوش مصنوعی عامل و عناصر تصمیمگیری آن را نظارت کند.

برای هر کسی که قصد دارد هوش مصنوعی را در سازمان خود ادغام کند و میخواهد مطمئن شود که این فناوری بهطور مسئولانه معرفی و حفظ میشود، پیشنهاد میکنم به اصول سازمان ملل متحد مراجعه کند. این ۱۰ اصل در سال ۲۰۲۲ توسط سازمان ملل متحد در پاسخ به چالشهای اخلاقی ناشی از افزایش حضور هوش مصنوعی تدوین شدهاند.

این ده اصل چیست و چگونه میتوان از آنها بهعنوان چارچوب استفاده کرد؟

۱. آسیب نرسانید

بهعنوان فناوری با عنصری خودمختار، اولین اصل بر استقرار سیستمهای هوش مصنوعی به گونهای تمرکز دارد که از هرگونه تأثیر منفی بر محیطهای اجتماعی، فرهنگی، اقتصادی، طبیعی یا سیاسی جلوگیری کند. چرخه عمر هوش مصنوعی باید بهگونهای طراحی شود که حقوق و آزادیهای انسانی را محترم شمارد و محافظت کند. این سیستمها باید نظارت شوند تا اطمینان حاصل شود که این وضعیت حفظ شده و هیچ آسیب بلندمدتی ایجاد نمیشود.

۲. از هوش مصنوعی بهخاطر خودش استفاده نکنید

اطمینان حاصل کنید که استفاده از هوش مصنوعی موجه، مناسب و بیش از حد نیست. وسوسهای آشکار برای استفاده بیش از حد مشتاقانه از این فناوری هیجانانگیز وجود دارد که باید با نیازها و اهداف انسانی متعادل شود و هرگز نباید به قیمت کرامت انسانی به کار گرفته شود.

۳. ایمنی و امنیت

ریسکهای ایمنی و امنیتی باید در طول چرخه عمر سیستم هوش مصنوعی و بهصورت مداوم شناسایی، رسیدگی و کاهش یابند. همان چارچوبهای قوی سلامت و ایمنی که در سایر حوزههای کسبوکار اعمال میشود، باید برای هوش مصنوعی نیز به کار گرفته شود.

۴. برابری

بهطور مشابه، هوش مصنوعی باید با هدف تضمین توزیع برابر و عادلانه مزایا، ریسکها و هزینهها به کار گرفته شود و از هرگونه تعصب، فریب، تبعیض و انگزنی جلوگیری کند.

۵. پایداری

هوش مصنوعی باید به ترویج پایداری زیستمحیطی، اقتصادی و اجتماعی کمک کند. ارزیابی مداوم باید انجام شود تا تأثیرات منفی، از جمله بر نسلهای آینده، مورد توجه قرار گیرد.

۶. حریم خصوصی دادهها، حفاظت از دادهها و حاکمیت دادهها

چارچوبها و مکانیزمهای حفاظت از دادهها و حاکمیت دادهها باید ایجاد یا تقویت شوند تا حریم خصوصی و حقوق افراد مطابق با رهنمودهای قانونی درباره یکپارچگی دادهها و حفاظت از دادههای شخصی حفظ شود. هیچ سیستم هوش مصنوعی نباید به حریم خصوصی انسان دیگری تعرض کند.

۷. نظارت انسانی

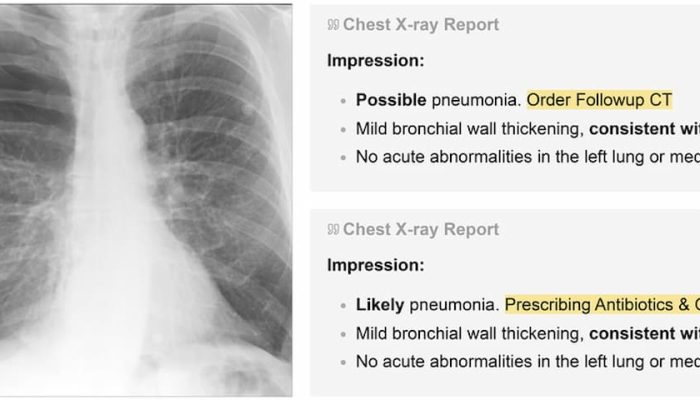

نظارت انسانی باید تضمین شود تا نتایج استفاده از هوش مصنوعی عادلانه و منصفانه باشد. شیوههای طراحی انسانمحور باید به کار گرفته شود و ظرفیت مداخله انسانی در هر مرحله برای تصمیمگیری درباره چگونگی و زمان استفاده از هوش مصنوعی و لغو هر تصمیم گرفتهشده توسط آن فراهم شود. سازمان ملل بهطور دراماتیک اما کاملاً معقول پیشنهاد میکند که هر تصمیمی که بر زندگی یا مرگ تأثیر بگذارد، نباید به هوش مصنوعی واگذار شود.

۸. شفافیت و توضیحپذیری

به نظر من، این بخش از رهنمودهای مربوط به برابری را تشکیل میدهد. هر کسی که از هوش مصنوعی استفاده میکند باید سیستمهایی که به کار میبرد، فرآیندهای تصمیمگیری آن و پیامدهایش را کاملاً درک کند. افراد باید مطلع شوند هنگامی که تصمیمی درباره حقوق، آزادیها یا مزایایشان توسط هوش مصنوعی گرفته شده است و مهمتر اینکه، توضیحات باید به شکلی قابلفهم ارائه شود.

۹. مسئولیتپذیری و پاسخگویی

این اصل سوتزنی است که شامل حسابرسی، دقت لازم و حمایت از سوتزنان میشود تا اطمینان حاصل شود که کسی مسئول و پاسخگوی تصمیمات گرفتهشده توسط هوش مصنوعی و استفاده از آن است. باید حاکمیتی برای مسئولیت اخلاقی و قانونی انسانها در قبال تصمیمات مبتنی بر هوش مصنوعی ایجاد شود. هر یک از این تصمیمات که آسیبرسان باشد باید بررسی و اقدامات لازم انجام شود.

۱۰. فراگیری و مشارکت

مانند هر حوزه دیگری در کسبوکار، هنگام طراحی، استقرار و استفاده از سیستمهای هوش مصنوعی، باید رویکردی فراگیر، بینرشتهای و مشارکتی اتخاذ شود که برابری جنسیتی را نیز در بر گیرد. ذینفعان و جوامعی که تحت تأثیر قرار میگیرند باید آگاه شوند، با آنها مشورت شود و از مزایا و ریسکهای احتمالی مطلع گردند.

ساخت ادغام هوش مصنوعی خود بر اساس این ستونهای مرکزی باید به شما اطمینان دهد که ورودتان به عرصه ادغام هوش مصنوعی بر پایهای اخلاقی و مستحکم بنا شده است.

منبع: اخبار هوش مصنوعی