ماه گذشته، گوگل از «هوش مصنوعی همکار علمی» رونمایی کرد؛ ابزاری که این شرکت مدعی است برای کمک به دانشمندان در تدوین فرضیهها و طرحهای پژوهشی طراحی شده است. گوگل این ابزار را راهی برای کشف دانش جدید معرفی کرد، اما کارشناسان معتقدند که این ابزار — و ابزارهای مشابه آن — به مراتب از وعدههای تبلیغاتی خود عقبتر هستند.

سارا بیری، پژوهشگر بینایی کامپیوتری در MIT، به تککرانچ گفت: «این ابزار اولیه، هرچند جالب به نظر میرسد، بعید است که به طور جدی مورد استفاده قرار گیرد. من مطمئن نیستم که جامعه علمی تقاضایی برای این نوع سیستم تولید فرضیه داشته باشد.»

گوگل آخرین غول فناوری است که این ایده را پیش میبرد که هوش مصنوعی روزی به طور چشمگیری سرعت تحقیقات علمی را افزایش خواهد داد، بهویژه در حوزههای پر از مقالات مانند زیستپزشکی. سام آلتمن، مدیرعامل OpenAI، در مقالهای در اوایل سال جاری اظهار داشت که ابزارهای «فوقهوشمند» هوش مصنوعی میتوانند «کشف و نوآوری علمی را به شدت تسریع کنند.» به همین ترتیب، داریو آمودی، مدیرعامل Anthropic، پیشبینی جسورانهای کرده است که هوش مصنوعی میتواند به تدوین درمان برای اکثر سرطانها کمک کند.

اما بسیاری از پژوهشگران معتقدند که هوش مصنوعی امروزی بهویژه در هدایت فرآیند علمی چندان مفید نیست. به گفته آنها، کاربردهایی مانند «هوش مصنوعی همکار علمی» گوگل بیشتر به نظر اغراقآمیز میآیند تا واقعی، و دادههای تجربی از آنها پشتیبانی نمیکند.

برای مثال، گوگل در پست وبلاگی که این ابزار را توصیف میکند، اعلام کرد که این ابزار پتانسیل خود را در حوزههایی مانند بازاستفاده دارو برای لوسمی میلوئید حاد — نوعی سرطان خون که مغز استخوان را تحت تأثیر قرار میدهد — نشان داده است. با این حال، نتایج آنقدر مبهم هستند که فاویا دوبیک، آسیبشناس وابسته به مرکز پزشکی نورثوست در توسان آریزونا، به تککرانچ گفت: «هیچ دانشمند معتبری این [نتایج] را جدی نمیگیرد.»

او افزود: «این میتواند نقطه شروع خوبی برای پژوهشگران باشد، اما […] کمبود جزئیات نگرانکننده است و اعتماد من را جلب نمیکند. اطلاعات ارائهشده آنقدر کم است که درک اینکه آیا واقعاً میتواند مفید باشد یا نه، بسیار دشوار است.»

این اولین بار نیست که جامعه علمی گوگل را به دلیل تبلیغ یک پیشرفت ادعایی در هوش مصنوعی بدون ارائه روشی برای بازتولید نتایج مورد انتقاد قرار میدهد. در سال ۲۰۲۰، گوگل مدعی شد که یکی از سیستمهای هوش مصنوعیاش که برای تشخیص تومورهای پستان آموزش دیده بود، نتایجی بهتر از رادیولوژیستهای انسانی به دست آورده است. پژوهشگرانی از هاروارد و استنفورد در مجله Nature پاسخی منتشر کردند و گفتند که فقدان روشها و کدهای دقیق در پژوهش گوگل «ارزش علمی آن را تضعیف میکند.»

دانشمندان همچنین گوگل را به دلیل نادیده گرفتن محدودیتهای ابزارهای هوش مصنوعیاش که برای رشتههای علمی مانند مهندسی مواد طراحی شدهاند، سرزنش کردهاند. در سال ۲۰۲۳، این شرکت اعلام کرد که حدود ۴۰ «ماده جدید» با کمک یکی از سیستمهای هوش مصنوعیاش به نام GNoME سنتز شدهاند. اما تحلیل خارجی نشان داد که حتی یک مورد از این مواد واقعاً جدید نبود.

آشیک خودابخش، استادیار مهندسی نرمافزار در مؤسسه فناوری روچستر، به تککرانچ گفت: «ما تا زمانی که ابزارهایی مانند «هوش مصنوعی همکار علمی» گوگل تحت ارزیابی دقیق و مستقل در رشتههای علمی متنوع قرار نگیرند، نمیتوانیم نقاط قوت و محدودیتهای آنها را بهدرستی درک کنیم. هوش مصنوعی اغلب در محیطهای کنترلشده عملکرد خوبی دارد، اما ممکن است در مقیاس بزرگ با شکست مواجه شود.»

فرآیندهای پیچیده

بخشی از چالش در توسعه ابزارهای هوش مصنوعی برای کمک به کشف علمی، پیشبینی تعداد بیشمار عوامل مخدوشکننده است. هوش مصنوعی ممکن است در حوزههایی که نیاز به کاوش گسترده دارند، مانند محدود کردن فهرست بزرگی از احتمالات، مفید باشد. اما مشخص نیست که آیا هوش مصنوعی قادر به حل خلاقانه مسائل به شیوهای است که به پیشرفتهای علمی منجر شود یا نه.

خودابخش گفت: «در طول تاریخ دیدهایم که برخی از مهمترین پیشرفتهای علمی، مانند توسعه واکسنهای mRNA، با شهود انسانی و پشتکار در برابر تردیدها به دست آمدهاند. هوش مصنوعی، همانطور که امروز وجود دارد، ممکن است برای بازتولید آن مناسب نباشد.»

لانا سیناپاین، پژوهشگر هوش مصنوعی در آزمایشگاههای علوم کامپیوتر سونی در ژاپن، معتقد است که ابزارهایی مانند «هوش مصنوعی همکار علمی» گوگل بر نوع نادرستی از کارهای علمی تمرکز دارند.

سیناپاین ارزش واقعی را در هوش مصنوعی میبیند که بتواند وظایف فنی دشوار یا خستهکننده مانند خلاصهسازی مقالات علمی جدید یا قالببندی کارها برای تطابق با الزامات درخواست کمکهزینه را خودکار کند. اما به گفته او، در جامعه علمی تقاضای چندانی برای یک «هوش مصنوعی همکار علمی» که فرضیه تولید کند وجود ندارد — وظیفهای که بسیاری از پژوهشگران از آن لذت فکری میبرند.

او به تککرانچ گفت: «برای بسیاری از دانشمندان، از جمله خودم، تولید فرضیه جذابترین بخش کار است. چرا باید لذتم را به یک کامپیوتر واگذار کنم و فقط کارهای سخت را برای خودم نگه دارم؟ به طور کلی، به نظر میرسد بسیاری از پژوهشگران هوش مصنوعی مولد درک درستی از انگیزههای انسانی ندارند، و در نتیجه پیشنهادهایی برای محصولاتی ارائه میدهند که بخشی را خودکار میکنند که ما از آن لذت میبریم.»

بیری خاطرنشان کرد که اغلب سختترین گام در فرآیند علمی، طراحی و اجرای مطالعات و تحلیلها برای تأیید یا رد یک فرضیه است — چیزی که لزوماً در دسترس سیستمهای هوش مصنوعی کنونی نیست. هوش مصنوعی البته نمیتواند از ابزارهای فیزیکی برای انجام آزمایشها استفاده کند و اغلب در مسائلی که دادههای بسیار محدودی وجود دارد، عملکرد بدتری دارد.

او گفت: «بیشتر علوم را نمیتوان کاملاً بهصورت مجازی انجام داد — اغلب بخش مهمی از فرآیند علمی وجود دارد که فیزیکی است، مانند جمعآوری دادههای جدید و انجام آزمایشها در آزمایشگاه. یکی از محدودیتهای بزرگ سیستمهایی [مانند هوش مصنوعی همکار علمی گوگل] نسبت به فرآیند علمی واقعی، که قطعاً کاربرد آن را محدود میکند، زمینهای درباره آزمایشگاه و پژوهشگری است که از سیستم استفاده میکند، اهداف پژوهشی خاص آنها، کارهای قبلیشان، مهارتهایشان، و منابعی که به آنها دسترسی دارند.»

خطرات هوش مصنوعی

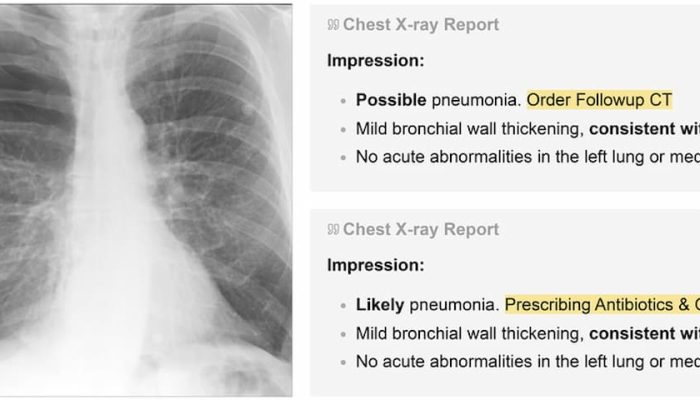

کاستیهای فنی و خطرات هوش مصنوعی — مانند تمایل آن به توهمزایی — نیز باعث شده است که دانشمندان نسبت به تأیید آن برای کارهای جدی محتاط باشند.

خودابخش نگران است که ابزارهای هوش مصنوعی به سادگی در ادبیات علمی سر و صدا ایجاد کنند، نه اینکه پیشرفت را ارتقا دهند.

این موضوع همین حالا هم یک مشکل است. مطالعهای اخیر نشان داد که «علم بیارزش» تولیدشده توسط هوش مصنوعی، گوگل اسکالر، موتور جستجوی رایگان گوگل برای ادبیات علمی، را پر کرده است.

او گفت: «پژوهش تولیدشده توسط هوش مصنوعی، اگر با دقت نظارت نشود، میتواند حوزه علمی را با مطالعات کمکیفیت یا حتی گمراهکننده پر کند و فرآیند بازبینی همتا را تحت فشار قرار دهد. فرآیند بازبینی همتا که همین حالا هم در رشتههایی مانند علوم کامپیوتر چالشبرانگیز است، با افزایش نمایی ارسالها به کنفرانسهای برتر مواجه شده است.»

سیناپاین گفت که حتی مطالعات طراحیشده نیز ممکن است به دلیل عملکرد نادرست هوش مصنوعی آلوده شوند. او در حالی که ایده ابزاری که بتواند در مرور و تلفیق ادبیات کمک کند را دوست دارد، گفت که به هوش مصنوعی امروزی برای انجام قابلاعتماد این کار اعتماد ندارد.

او افزود: «اینها چیزهایی هستند که ابزارهای موجود ادعا میکنند انجام میدهند، اما اینها کارهایی نیستند که من شخصاً به هوش مصنوعی کنونی واگذار کنم. حتی اگر تمام مسائل اخلاقی […] حل شوند، هوش مصنوعی فعلی به اندازه کافی قابلاعتماد نیست که کارم را بر اساس خروجیهای آن بنا کنم.»